Ein Governance-Beispiel aus einem Hochvertrauenssystem – und konkrete Ableitungen für KI-gestützte Übersetzung und Dolmetschen in Verwaltung und Unternehmen

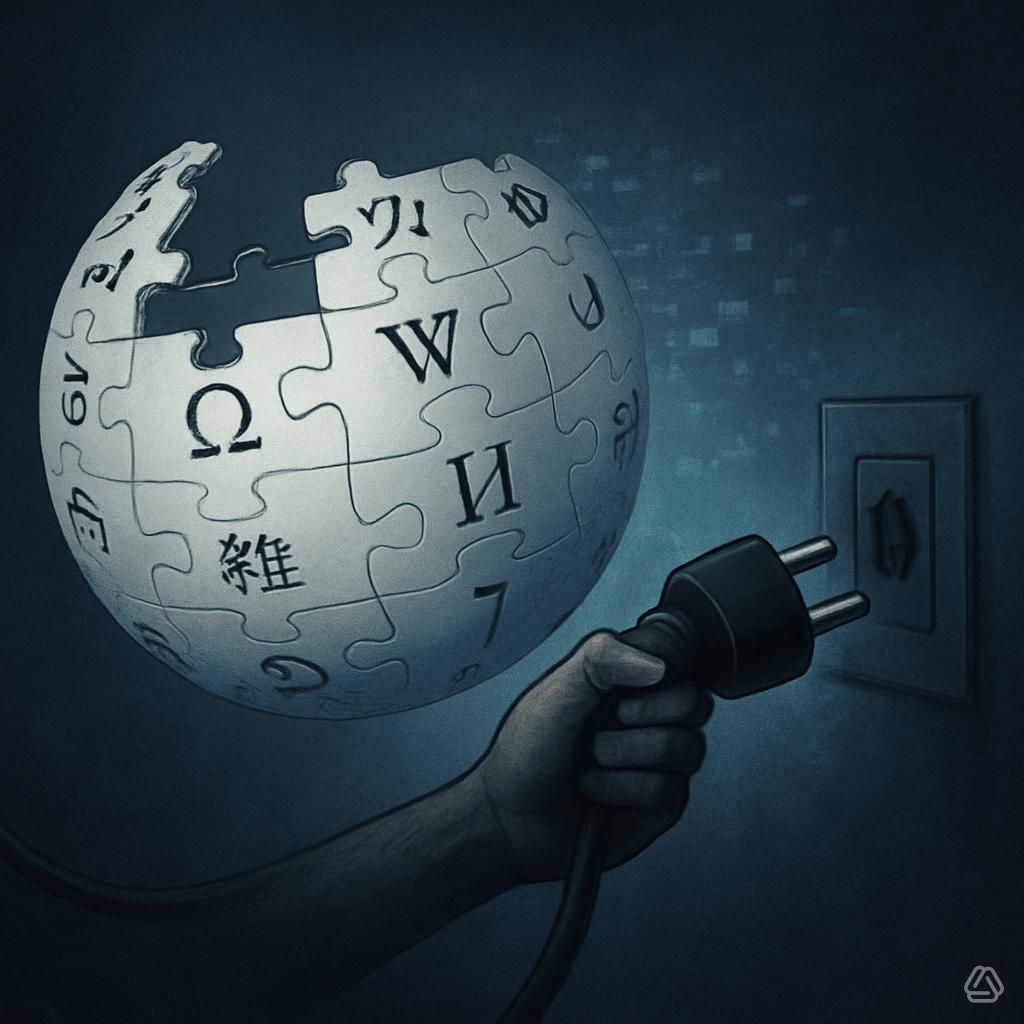

Wikipedia ist kein „nettes Internetprojekt“, sondern ein Hochvertrauenssystem: Millionen Menschen nutzen Inhalte als Referenz, und die Community arbeitet mit klaren Regeln, Nachweislogik und öffentlicher Rechenschaft. Genau deshalb ist der jüngste Schritt so lehrreich: Berichten zufolge werden KI-geschriebene Artikel nach Policy-Verstößen konsequenter entfernt bzw. nicht akzeptiert – während begrenzte KI-Nutzung (z. B. zur Übersetzung zwischen Sprachversionen) weiterhin möglich bleibt, wenn sie transparent, geprüft und verantwortet ist.

Die wichtige Linie verläuft nicht zwischen „KI ja/nein“, sondern zwischen:

Für öffentliche Hand, regulierte Branchen und Enterprise-Teams ist das ein praktischer Governance-Fall: Welche KI-Nutzung ist akzeptabel, weil sie auditierbar und kontrollierbar ist – und welche nicht?

Wenn ein System auf Vertrauen gebaut ist, reichen „gute Ergebnisse“ nicht. Entscheidend ist:

KI-geschriebene Artikel scheitern häufig genau daran: Sie können plausibel klingen, aber Quellen falsch wiedergeben, Zitate erfinden oder Gewichtungen verzerren. Für Wikipedia ist das nicht nur Qualitäts-, sondern Governance-Versagen: Inhalte ohne robuste Nachweiskette sind nicht kompatibel mit dem System.

Für Entscheider:innen ist die Wikipedia-Linie hilfreich, weil sie in Governance übersetzbar ist:

1) KI-generierter Originalinhalt (in Hochrisiko-Umgebungen meist nicht akzeptabel)

Typische Probleme:

In Verwaltung, Gesundheitswesen, Justiz, Finanzbereich oder kritischer Infrastruktur entspricht das oft: nicht zulässig für externe Kommunikation, Bescheide, Aufklärungsunterlagen, Protokolle, Richtlinien oder alles, was rechtliche/medizinische Folgen haben kann.

2) KI-assistierte Workflows (akzeptabel, wenn Regeln klar sind)

Die Übersetzungslogik bei Wikipedia ist ein Beispiel: KI darf helfen, aber Editor:innen müssen prüfen, anpassen, Quellen respektieren und Policies einhalten.

Übertragen auf Organisationen: KI ist ein Werkzeug in einer kontrollierten Prozesskette – nicht der Autor.

Wenn Sie KI für Übersetzung oder Dolmetsch-Workflows einsetzen, ist das Ziel nicht „maximale Automatisierung“, sondern maximale Verlässlichkeit bei minimalem Aufwand. Ein praktikables Modell besteht aus fünf Bausteinen.

Definieren Sie Risikoklassen, die bestimmen, wie viel menschliche Kontrolle nötig ist.

Beispiel für ein pragmatisches Tiering:

Wichtiger Effekt: Sie schaffen eine Governance, die Teams im Alltag tatsächlich anwenden können – statt einer „KI darf nie“- oder „KI darf immer“-Regel.

Wikipedia funktioniert, weil es eine klare Rolle gibt, die Verantwortung trägt: Editor:innen.

Übertragen heißt das:

Ein praktischer Grundsatz: KI kann beitragen, aber nie „veröffentlichen“. Veröffentlichung/Weitergabe braucht eine menschliche Freigabe – je nach Tier streng oder leichtgewichtig.

KI-Outputs müssen prüfbar sein. Setzen Sie daher standardisierte Kontrollen ein:

Das ist die Übersetzung der Wikipedia-Logik „Belege und Policy zuerst“ in einen Sprachprozess.

In Hochvertrauensumgebungen müssen Sie später beantworten können:

Das muss nicht bürokratisch sein, aber es muss systematisch sein. Ohne Audit-Trail wird KI-Nutzung schnell zum Compliance- und Reputationsrisiko.

Wikipedias Problem war nicht nur Technik, sondern Regelbruch. Organisationen brauchen daher kurze, harte Leitplanken:

Das reduziert Fehlanwendungen deutlich, weil Mitarbeitende wissen, was erlaubt ist – und was nicht.

Praktische Implikation für Entscheider:innen: Die harte Linie kommt auch in Ihre Organisation

Wikipedia ist ein Frühindikator: Systeme mit hoher öffentlicher Wirkung ziehen Grenzen dort, wo Verantwortung und Nachweisbarkeit verschwimmen.

In Beschaffung, Governance und Projektsteuerung sollten Sie deshalb weniger nach „KI-Features“ fragen – und mehr nach:

Wenn Anbieter nur „bessere Übersetzungen“ versprechen, aber keinen prüfbaren Prozess liefern, ist das genau die Falle, die Wikipedia gerade sichtbar macht.

Die Wikipedia-Entscheidung ist weniger „KI-Bashing“ als Governance in Reinform: Originalcontent ohne belastbare Nachweiskette wird nicht akzeptiert; KI als Assistenz kann funktionieren, wenn Menschen Verantwortung tragen, Quellen respektieren und Qualität systematisch kontrollieren.

Für Übersetzung und Dolmetschen heißt das: Bauen Sie Workflows, die KI produktiv nutzen, aber die Kernanforderungen hochregulierter Umgebungen erfüllen: Rechenschaft, Qualität, Auditierbarkeit und risikobasierte Steuerung.

Optionaler nächster Schritt

Wenn Sie KI-gestützte Sprachworkflows einführen (oder neu ausschreiben), starten Sie mit einem einseitigen Governance-Entwurf: Risikostufen, Freigaberegeln, QA-Checks und Auditfelder. Das schafft Klarheit – intern wie gegenüber Lieferanten – bevor die Technikentscheidungen getroffen werden.